研究テーマ

3次元ビジョン研究室は主にコンピュータビジョン,マシンビジョンの分野で活動しています.

研究内容は多岐に渡りますが,どれも3次元画像計測,3次元物体認識の技術を基本にしています.

以下に主な研究内容について簡単に紹介致します.

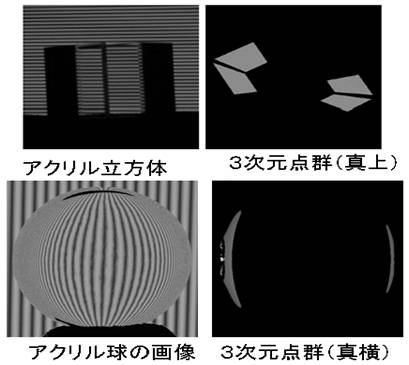

3次元画像計測

アクティブステレオ計測による3次元画像計測の研究を行っています.

多くの物体はこれまでに提案されていた位相シフト法やランダムパターン投影などで計測が可能ですが,

これまでの手法では鏡などの鏡面物体や金属などの光沢反射面を有する物体は計測が困難でした.

そこで単一方向の光しか投影しないプロジェクターではなく,様々な方向に光を発するディスプレイを用い,反射面の法線方向が同じであることを利用し,鏡面物体の計測を可能にしています.

またガラスなど光を屈折反射してしまう物体に対しても,その屈折率を予め既知とすることで,計測するアルゴリズムを考案しています.

これだけでなく,今までの3次元画像計測技術は1枚の距離画像を得るためにある程度の時間が必要だったため,動物体の3次元復元が困難でしたが,

これを可能にする超高速3次元画像計測技術の開発なども行っています.

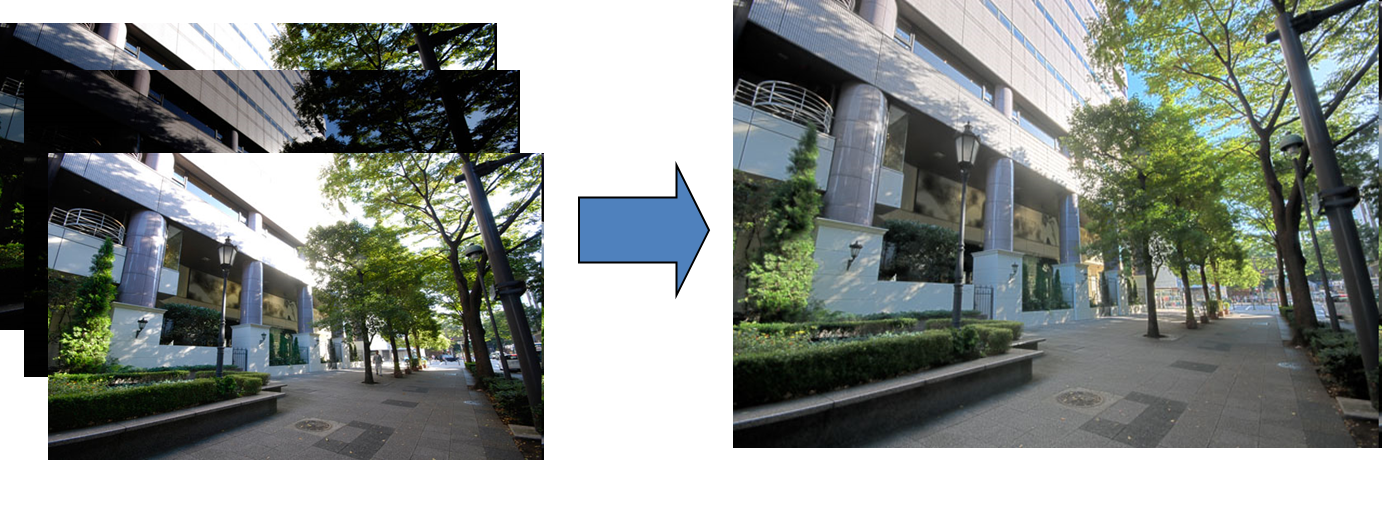

ハイダイナッミックレンジ画像生成

デジタル写真を撮る際,ダイナミックレンジが広いために通常のカメラのダイナミックレンジでは表現しきれない場合があります.

(例えば風景写真の中で太陽などは明るすぎて白く飛んでしまい,影の中の領域は黒く潰れてしまうなど)

そこで露出の異なる画像を複数枚用意し,これらを合成することで通常よりも高いダイナミックレンジを表現できるハイダイナミックレンジ画像の生成を行っています.

画像を合成する際に問題となるのが,それぞれの画像の画素値を決定する応答関数を滑らかに接続することです.

既存の手法では,照度値のlogとピクセル値の関係を求めることでハイダイナミックレンジ画像の生成を行っていましたが,

我々はlogを取らず,より対数歪みの少ない応答関数の復元手法を提案しています.

移動ロボット

ロボットが自ら環境を認識し,自律行動を行う研究を行っています.

従来の移動ロボットは,ユーザがリモコン等で操作をする,もしくは予め指定した動作のみを行うものがほとんどで,

自らの置かれた環境をリアルタイムに認識し,それに合わせた自律動作を行うものはそれほど多くありません.

これらを実現するためには,環境の認識,自己位置の推定,経路作成,動作制御,観測情報のフィードバックなど多くの技術が必要です.

我々はこれらの課題の解決を画像,距離センサを用いて行っています.

床面に引かれたカラーテープを画像処理を用いて検出するライントレース技術と,

検出したラインの情報によるビジュアルサーボ,

距離センサを用いた障害物の検出とそれに合わせた経路作成などを行っています.

他にも距離センサを用いて廊下やエレベーターホールなどを認識し自己位置推定する手法も研究しています.

3次元物体認識

距離センサを使い,あらかじめ登録しておいた3次元のモデルを実空間上から探し出す3次元物体認識を行っています.

剛体の3次元物体認識は登録モデルと計測データの位置合わせ問題として捉えることができます.

位置合わせにはICP(Iterative Closest Point)アルゴリズムがよく用いられますが,

この手法は2つのデータの位置姿勢が大まかに合っていることが前提にありました.

そのためまず大まかな位置合わせが必要になりますが,我々は全探索を用いて大まかな位置合わせを行っています.

全探索なため,本来であれば大規模な計算が必要となりますが,

モデルからの距離登録と非極値抑制を用いて計算コストを削減することで,

ロバストかつ高速な3次元認識を実現しています.

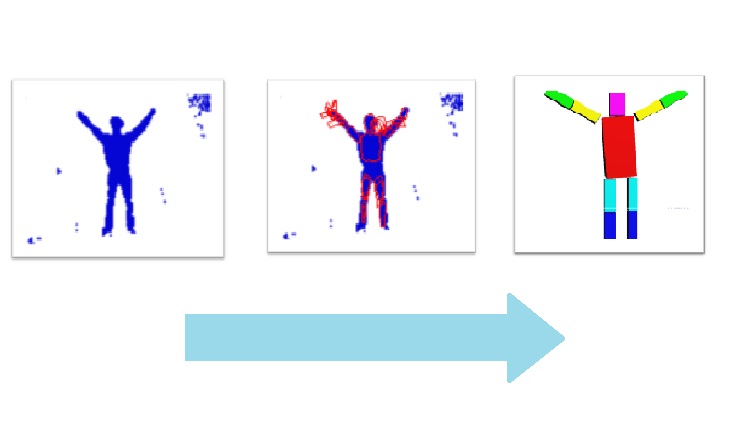

人体の姿勢推定

人間の認識は古くからあるコンピュータビジョンにおける課題です.

人間の体は顔のように決まったパターンが定まっておらず,ほぼ自由形状であるため,その認識が困難でした.

我々は,人間の体は頭,胴体,上腕,下腕といったパーツに分けて考えると,ほぼ剛体とみなせること,

それらのパーツの接続関係が既知であること(下腕⇔上腕⇔胴体が繋がっている,など)を考慮することで,

人体の姿勢推定を実現しようとしています.

手法には全探索を用い,ロバストな認識かつ実時間での処理を目指しています.

ジェスチャー認識

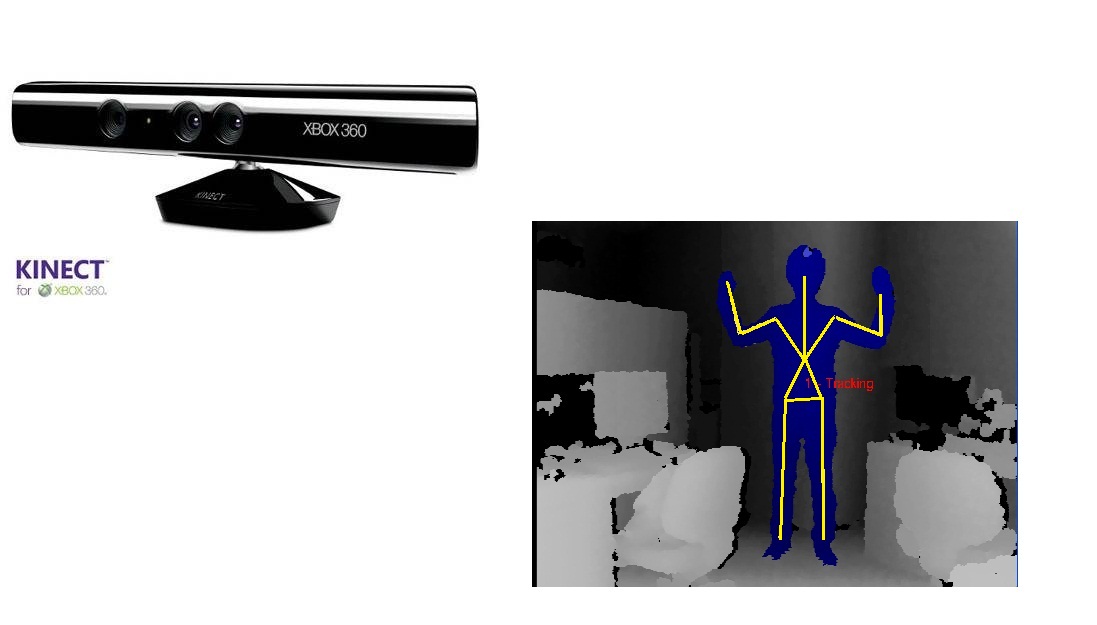

2010年にマイクロソフトよりXbox360用のコントローラとしてkinectが発売されました.

この機器は非常に安価に距離データを取得できる距離センサであること,

得られた距離データの中から人とその姿勢の認識が可能であり,またその追跡もできることが特徴でした.

そこでこのデバイスをブレイクスルーとして,新しい入力インタフェースの発展が期待されています.

我々は人間の体の動作を認識することで,直感的な入力が可能になるよう研究を行っています.

これまでのような単純なDPマッチングによる認識ではなく,

動作の速度や加速度を考慮した手法を提案しています.

MR

近年,現実世界に仮想の情報を付与する,AR(拡張現実感)やMR(複合現実感)の研究が盛んに行われています.

これらAR/MRを実現するためには,位置姿勢の推定が必要となります.

この推定手法として最も一般的なのが,マーカを用意し,それらの画像認識により推定する手法です.

しかしながらこれにはマーカを用意せねばならず,景観を損なうことが問題になっています.

そこで自然特徴点を用いた手法などが提案されてきていますが,

確実に取得できる訳ではなく,正確な位置姿勢推定が困難な場合があります.

そこで我々は距離センサを用い,計測点群全てを用いた位置合わせを行うことで,位置姿勢推定を実現しています.

AM/MRの実現にはHMD(Head Mounted Display)を用いています.

スポーツ3D

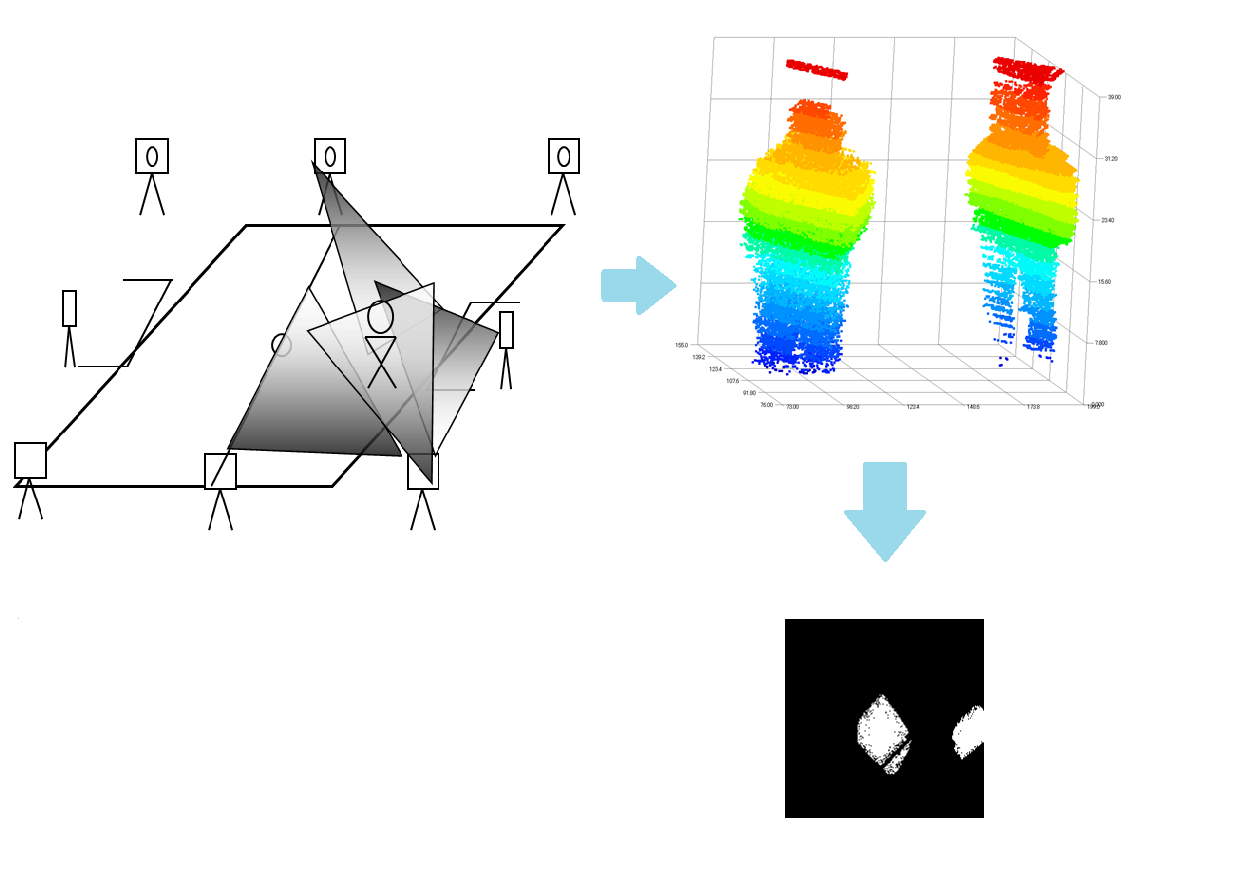

多同期カメラを用いることで,リアルタイムに選手の動作解析を行う研究をしています.

近年,動画解析のスポーツシーンへの応用は活発に行われており,実際に多くのスポーツの戦略やトレーニングに生かされています.

中継のあるプロスポーツであれば,選手の動作を数値化したものを同時に配信することで,より視聴者が楽しめるようにもなります.

しかしながらこれをリアルタイムに解析し提供するシステムというのはまだ完成されていません.

我々は視体積交差法と呼ばれる複数カメラを用いた計測を高精度化,高速化し,

スポーツに特化したシステムとすることでリアルタイム動作解析の実現を目指しています.

More Information

- 3次元ビジョン研究室過去の研究- 研究実績