Static2Dynamic GANを用いた表情動画像の生成

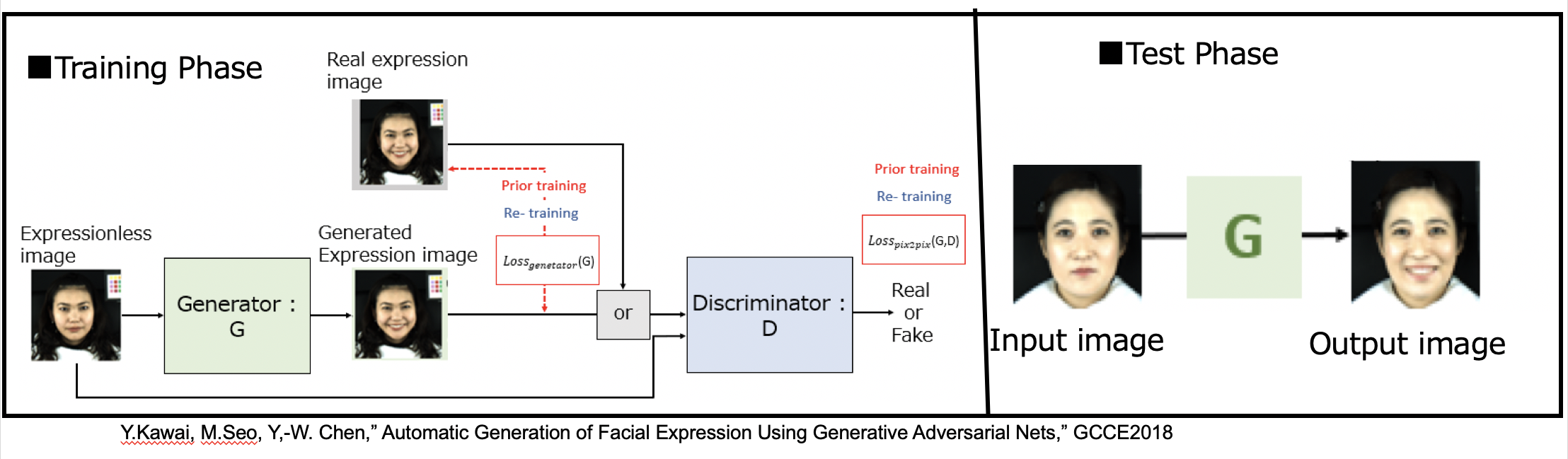

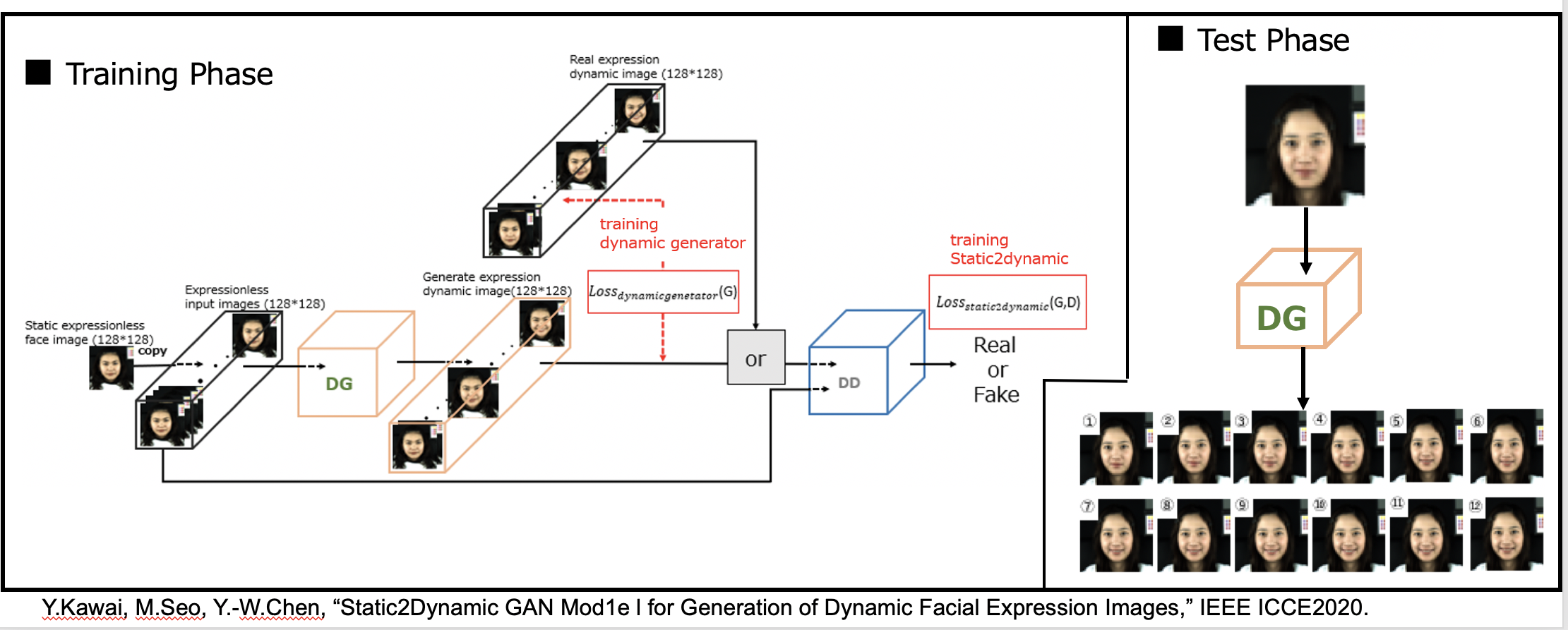

1枚の静止画像から1枚の静止画像の生成法としてpx2pixというGANがよく用いられる。様々なGANの中で最も有名なGANの一つである。その他に学習データとしてペア画像を必要としないCycle GANもあります。本研究では、1枚の静止画像(static image)から動画像(dynamic image)を生成するStatic2Dynamic GANを新たに提案する。static2Dynamic GANを用いると、1枚の静止無表情顔画像から表情動画像を生成することができる。Fig.1はpix2pixのネットワークと1枚の無表情顔画像から1枚の笑顔画像を生成した結果である。Fig.2は提案法のStatic2Dynamic GANのネットワークと1枚の無表情顔画像から生成された32枚の笑顔の動画像である。

Fig.1. pix2pixのネットワークと1枚の無表情顔画像から生成した1枚の笑顔画像

Fig.2. 提案法Static2Dynamicのネットワークと1枚の無表情顔画像から生成された32枚の笑顔の動画像

関連発表論文:

1. Yoshiharu Kawai, Masataka Seo, and *Yen-Wei Chen, “Static2Dynamic GAN Mod1e l for Generation of Dynamic Facial Expression Images,” 38th IEEE International Conference on Consumer Electronics (IEEE ICCE2020), Las Vegas, USA, Jan. 4-6, 2020.(Link)

2. Yoshiharu Kawai, Masataka Seo, Yen-Wei Chen, “Automatic Generation of Facial Expression Using Generative Adversarial Nets,” Proc. of 2018 IEEE 7th Global Conference on Consumer Electronics (GCCE 2018), Nara, Japan, Oct.9-12, 2018. (Link)